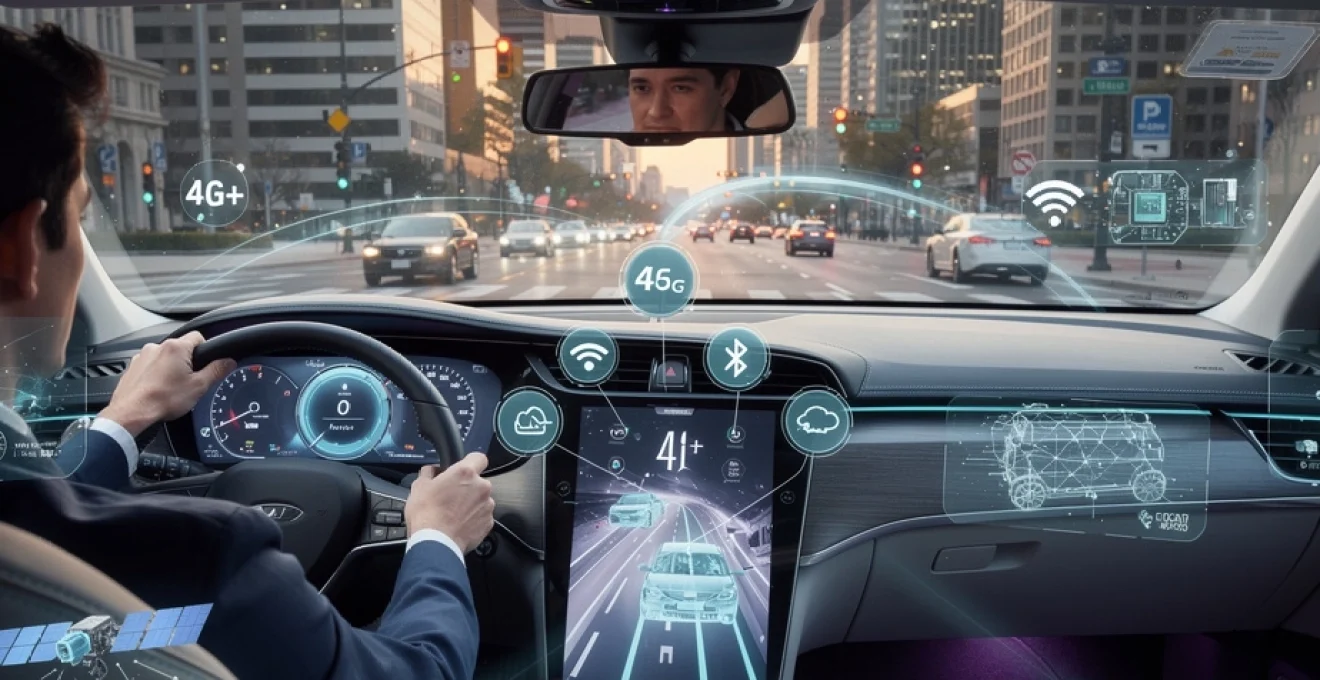

La révolution numérique transforme radicalement l’industrie automobile, faisant des véhicules de véritables ordinateurs roulants équipés de technologies sophistiquées. Les voitures connectées d’aujourd’hui intègrent une multitude de systèmes électroniques avancés qui redéfinissent l’expérience de conduite et ouvrent la voie vers l’autonomie complète. Cette évolution technologique représente un changement paradigmatique où l’électronique pourrait représenter jusqu’à 35% de la valeur d’une voiture électrique d’ici 2030, contre seulement 15% actuellement pour les véhicules thermiques. L’interconnexion de ces technologies crée un écosystème complexe permettant aux véhicules de communiquer avec leur environnement, d’apprendre des habitudes de leurs utilisateurs et d’évoluer continuellement grâce aux mises à jour logicielles.

Systèmes de connectivité et protocoles de communication automobile

Les fondements d’une voiture connectée reposent sur des infrastructures de communication robustes capables d’assurer une connectivité permanente et fiable. Cette connectivité multi-protocoles permet aux véhicules d’interagir avec une multitude d’acteurs : autres véhicules, infrastructure routière, services cloud et appareils personnels des occupants. L’architecture de communication moderne doit gérer simultanément plusieurs flux de données critiques pour la sécurité et le confort.

Technologies 4G LTE et 5G embarquées dans les véhicules tesla model S et BMW idrive

La connectivité cellulaire constitue l’épine dorsale des services connectés modernes. Les modules 4G LTE intégrés permettent déjà aux véhicules comme la Tesla Model S de bénéficier de débits atteignant 150 Mbps en réception, suffisants pour le streaming vidéo haute définition et les mises à jour logicielles volumineuses. Le système BMW iDrive exploite cette connectivité pour proposer des services de navigation en temps réel, intégrant les données de trafic actualisées toutes les minutes.

L’arrivée de la 5G révolutionne ces capacités avec des débits théoriques de 10 Gbps et une latence réduite à moins de 1 milliseconde. Cette performance permet d’envisager des applications critiques comme la coordination entre véhicules autonomes ou la télémaintenance avancée. Les antennes 5G embarquées utilisent la technologie MIMO (Multiple Input Multiple Output) avec jusqu’à 64 antennes pour optimiser la réception dans un environnement mobile complexe.

Protocoles bluetooth 5.0 et Wi-Fi 6 pour l’écosystème android auto et apple CarPlay

Le Bluetooth 5.0 apporte des améliorations significatives par rapport aux versions précédentes, avec une portée quadruplée atteignant 240 mètres en champ libre et une vitesse de transmission doublée. Cette technologie permet une connectivité transparente des smartphones et accessoires connectés, réduisant les interruptions de connexion fréquentes dans les anciens systèmes. La consommation énergétique réduite du Bluetooth 5.0 préserve l’autonomie des appareils connectés.

Le Wi-Fi 6 (802.11ax) révolutionne la connectivité intra-véhicule avec des débits atteignant 9,6 Gbps théoriques et une gestion optimisée de multiples appareils simultanés. Android Auto et Apple CarPlay tirent parti de ces protocoles pour offrir une intégration native des applications mobiles, permettant aux passagers de projeter leur écosystème numérique sur les écrans du véhicule.

En pratique, cela signifie que vous pouvez lancer une playlist Spotify, répondre à un appel WhatsApp ou suivre un itinéraire Waze via Android Auto ou Apple CarPlay, sans latence perceptible. Le Wi‑Fi 6 gère mieux les interférences, ce qui est crucial dans un habitacle déjà saturé d’ondes (smartphones, montres connectées, tablettes des enfants, etc.). Couplés, Bluetooth 5.0 et Wi‑Fi 6 forment le socle de l’écosystème numérique de la voiture connectée, tout en préparant l’arrivée de services plus gourmands comme le cloud gaming embarqué ou la visioconférence en déplacement.

Communication V2X (Vehicle-to-Everything) et standard DSRC pour la conduite autonome

Au‑delà de la connexion au cloud, la voiture connectée moderne doit aussi « parler » avec tout ce qui l’entoure : c’est le principe de la communication V2X (Vehicle-to-Everything). Cette technologie regroupe les échanges V2V (véhicule à véhicule), V2I (véhicule à infrastructure), V2P (véhicule à piéton) et V2N (véhicule au réseau). L’objectif est simple : anticiper les situations dangereuses bien avant que le conducteur – ou même les capteurs embarqués – ne puissent les percevoir.

Historiquement, le standard DSRC (Dedicated Short Range Communications), basé sur la norme IEEE 802.11p, a été le premier pilier de la communication V2X. Fonctionnant dans la bande de 5,9 GHz, il permet un échange direct et à faible latence entre véhicules et éléments de l’infrastructure (feux tricolores, panneaux de signalisation, bornes de péage). Concrètement, un feu rouge peut prévenir votre voiture qu’il va passer au vert, ou un véhicule en amont peut signaler un freinage d’urgence plusieurs centaines de mètres avant que vous ne le voyiez.

Avec l’essor de la 5G, le C‑V2X (Cellular‑V2X) prend le relais ou complète le DSRC. Cette approche exploite le réseau cellulaire pour étendre la portée des communications et centraliser certaines informations dans le cloud, par exemple pour la gestion coordonnée du trafic en ville. Vous vous demandez ce que cela change pour vous ? Dans un scénario de conduite autonome, votre véhicule pourra recevoir en quasi temps réel des alertes sur un piéton masqué par un camion, un accident derrière un virage ou une chaussée glissante détectée par d’autres véhicules.

À court terme, DSRC et C‑V2X coexisteront dans de nombreux pays, les régulateurs n’ayant pas encore tranché définitivement. À plus long terme, la tendance industrielle semble toutefois favoriser le C‑V2X pour sa meilleure évolutivité et sa compatibilité naturelle avec les réseaux 5G et les services cloud avancés. Pour les systèmes de conduite autonome de niveau 3 et au‑delà, cette couche de communication V2X deviendra un maillon essentiel de la « ceinture de sécurité numérique » qui entoure chaque véhicule.

Architectures CAN bus et ethernet automotive pour l’interconnexion des modules

Si la connectivité externe est essentielle, la véritable « colonne vertébrale » d’une voiture connectée reste son réseau interne. Pendant des décennies, le bus CAN (Controller Area Network) a été le standard de fait dans l’industrie automobile pour relier calculateurs, capteurs et actionneurs. Robuste, tolérant aux interférences et relativement peu coûteux, le CAN gère encore aujourd’hui la plupart des fonctions critiques : freinage, direction assistée, airbags, gestion moteur, etc.

Cependant, l’augmentation explosive des données à transporter – caméras haute résolution, radars, LiDAR, écrans 4K, streaming vidéo – a mis en évidence les limites de débit du CAN (souvent limité à 1 Mbit/s). Pour y répondre, les constructeurs migrent progressivement vers des architectures Ethernet automotive, capables d’atteindre 100 Mbit/s, 1 Gbit/s, voire davantage. Contrairement au CAN, Ethernet peut transporter simultanément trafic temps réel (sécurité) et trafic non critique (infodivertissement) via des mécanismes de priorisation comme Time-Sensitive Networking (TSN).

Cette transition s’accompagne d’une évolution architecturale majeure : on passe d’une multitude d’ECU (calculateurs) spécialisés et dispersés vers des contrôleurs de domaine plus centralisés. Imaginez un cerveau unique par grande fonction (conduite autonome, infotainment, groupe motopropulseur) plutôt qu’une constellation de petits cerveaux isolés. Le CAN Bus continue de jouer un rôle clé pour les fonctions à faible débit et très critiques, tandis qu’Ethernet automotive prend en charge les gros flux de données nécessaires aux systèmes avancés de perception et d’expérience utilisateur.

Intelligence artificielle et systèmes d’assistance à la conduite ADAS

Les systèmes d’aide à la conduite (ADAS) sont le visage le plus visible de l’intelligence artificielle dans la voiture connectée. Du régulateur de vitesse adaptatif au maintien dans la voie, en passant par le freinage automatique d’urgence, tous ces systèmes s’appuient sur une combinaison de capteurs, de processeurs puissants et d’algorithmes avancés. L’enjeu ? Réduire drastiquement les accidents, dont près de 95 % sont encore dus à une erreur humaine, tout en préparant en douceur la transition vers la conduite autonome.

Processeurs NVIDIA drive PX2 et puces qualcomm snapdragon automotive

Pour traiter en temps réel les flux massifs de données issus des capteurs (caméras, radars, LiDAR, ultrasons), la voiture connectée embarque de véritables « supercalculateurs sur roues ». La plateforme NVIDIA Drive PX2, par exemple, a marqué une étape importante en offrant la puissance nécessaire pour analyser simultanément des dizaines de flux vidéo et de signaux radar. Ce type de processeur graphique (GPU) optimisé pour le deep learning permet d’exécuter des réseaux de neurones complexes directement dans le véhicule, sans dépendre en permanence du cloud.

De leur côté, les puces Qualcomm Snapdragon Automotive se positionnent à l’interface entre infotainment et ADAS. Elles intègrent CPU, GPU, modules de connectivité 4G/5G, Wi‑Fi, Bluetooth et parfois même un processeur dédié à l’IA (NPU). Résultat : un tableau de bord fluide, des interfaces graphiques avancées, une reconnaissance vocale performante et la possibilité de faire tourner des algorithmes de vision par ordinateur pour la détection de panneaux, de piétons ou de lignes de voie.

Pourquoi est‑ce si important ? Parce qu’en matière de sécurité, chaque milliseconde compte. Plus le calcul est effectué localement et rapidement, plus le véhicule peut réagir tôt à un danger (un freinage brusque, un animal surgissant sur la route, un véhicule en dépassement). Ces processeurs automotive sont spécialement conçus pour fonctionner dans des environnements difficiles (vibrations, températures extrêmes) tout en respectant des normes de sûreté fonctionnelle strictes comme l’ISO 26262.

Algorithmes de machine learning pour la reconnaissance vocale amazon alexa auto

L’intelligence artificielle ne se limite pas à la conduite : elle transforme également la façon dont vous interagissez avec votre voiture. Les assistants vocaux embarqués, comme Amazon Alexa Auto, reposent sur des algorithmes de machine learning capables de comprendre un langage naturel de plus en plus complexe. Plutôt que de mémoriser des commandes rigides, vous pouvez dire « Alexa, trouve une borne de recharge rapide sur mon trajet » ou « baisse la température côté passager » et laisser l’IA interpréter votre intention.

Ces systèmes de reconnaissance vocale combinent modèles acoustiques, modèles de langage et, de plus en plus, modèles contextuels. Ils apprennent de vos habitudes : parcours fréquents, stations de radio préférées, réglages du siège, horaires de départ habituels. Comme un bon assistant personnel, l’IA anticipe vos besoins, par exemple en proposant automatiquement un itinéraire alternatif lorsque les embouteillages sont récurrents sur votre trajet domicile‑travail.

Sur le plan technique, une partie du traitement peut être effectuée en local, pour réduire la latence et garantir un fonctionnement même en zone blanche. Le reste est traité dans le cloud, où des modèles plus lourds et régulièrement mis à jour améliorent en continu la compréhension et la pertinence des réponses. La confidentialité des données vocales devient alors un enjeu majeur, obligeant les constructeurs et partenaires comme Amazon à mettre en place des mécanismes stricts de consentement et d’anonymisation.

Systèmes LiDAR velodyne et caméras mobileye EyeQ4 pour la perception environnementale

Pour qu’une voiture connectée puisse réellement « comprendre » son environnement, elle doit être capable de le voir, le mesurer et le modéliser en trois dimensions. C’est là qu’interviennent les systèmes LiDAR (Light Detection and Ranging) comme ceux de Velodyne, et les caméras intelligentes associées à des processeurs tels que Mobileye EyeQ4. Le LiDAR émet des faisceaux laser et mesure le temps de retour pour reconstruire une carte 3D très précise des alentours, y compris de nuit ou dans des conditions de faible contraste visuel.

Les caméras gérées par les puces Mobileye, quant à elles, excellent dans l’interprétation sémantique de la scène : identification des panneaux de signalisation, reconnaissance des piétons, des cyclistes, des lignes de voie, des feux tricolores. L’EyeQ4 est capable de traiter plusieurs flux vidéo simultanés tout en appliquant des algorithmes de deep learning optimisés pour un faible encombrement énergétique, un point crucial pour l’autonomie des véhicules électriques.

LiDAR et caméras sont complémentaires : le premier fournit une géométrie extrêmement précise, le second apporte le contexte. Imaginez un conducteur qui aurait à la fois une vision parfaite des distances et une capacité instantanée à lire et comprendre tous les panneaux et signaux lumineux : c’est ce duo qui se met en place dans la voiture connectée. À mesure que les coûts des LiDAR baissent et que leur miniaturisation progresse, on les retrouve non seulement sur le toit des prototypes, mais aussi intégrés discrètement dans les boucliers ou la calandre des modèles de série haut de gamme.

Technologies de fusion sensorielle radar-caméra pour l’autonomous emergency braking

Un seul capteur ne suffit pas pour garantir une sécurité maximale. C’est pourquoi les constructeurs recourent à la fusion sensorielle, qui combine les informations de plusieurs sources, notamment radars et caméras, pour prendre des décisions plus fiables. Le système de freinage automatique d’urgence (AEB – Autonomous Emergency Braking) en est un exemple emblématique : il doit détecter en quelques millisecondes un obstacle, estimer la distance, calculer la vitesse relative et décider si un freinage d’office est nécessaire.

Les radars sont très performants pour mesurer les distances et vitesses, même par mauvais temps ou dans le brouillard, mais ils offrent une image peu détaillée. Les caméras, au contraire, fournissent une riche information visuelle mais sont plus sensibles aux conditions d’éclairage. En fusionnant ces deux types de données via des algorithmes dédiés (filtres de Kalman, réseaux de neurones multimodaux, etc.), le système AEB réduit les faux positifs (freinages injustifiés) et les faux négatifs (obstacles non détectés).

Pour vous, conducteur, cela se traduit par une intervention plus naturelle et plus fiable : la voiture vous alerte d’abord par un signal sonore et visuel, puis déclenche le freinage si vous ne réagissez pas à temps. Dans de nombreux cas, cela permet soit d’éviter totalement la collision, soit d’en réduire fortement la gravité. D’ici 2030, la plupart des organismes de sécurité routière prévoient que les systèmes AEB et autres ADAS avancés seront aussi incontournables que les airbags aujourd’hui.

Plateformes logicielles et systèmes d’exploitation embarqués

Derrière les écrans tactiles sophistiqués et les interfaces vocales fluides se cache une couche logicielle complexe, composée de systèmes d’exploitation temps réel, de middlewares et de frameworks d’applications. Une voiture connectée moderne peut embarquer plusieurs dizaines de millions de lignes de code, soit davantage qu’un avion de ligne. La qualité, la modularité et la sécurité de ces plateformes logicielles conditionnent directement la fiabilité, la réactivité et l’évolutivité du véhicule tout au long de sa vie.

Architecture QNX et linux automotive grade pour l’infodivertissement mercedes MBUX

De nombreux systèmes d’infodivertissement haut de gamme, comme le Mercedes MBUX, s’appuient sur des architectures hybrides mélangeant QNX et Linux Automotive Grade. QNX est un système d’exploitation temps réel réputé pour sa stabilité et sa certification en matière de sûreté fonctionnelle. Il est souvent utilisé pour les fonctions critiques (cluster d’instrumentation, ADAS, passerelles réseau sensibles), là où un plantage n’est tout simplement pas acceptable.

Linux Automotive Grade (AGL), de son côté, fournit une base ouverte et flexible pour les applications d’infodivertissement : navigation, multimédia, boutique d’applications, intégration des services en ligne. Cette combinaison permet d’isoler les fonctions vitales du véhicule des applications plus « grand public » susceptibles d’évoluer fréquemment. C’est un peu comme si, dans un immeuble, vous aviez une structure porteuse en béton armé (QNX) et des cloisons modulables (Linux AGL) que l’on peut adapter au fil du temps.

Mercedes utilise cette approche pour proposer une interface MBUX riche, personnalisable et constamment mise à jour, tout en garantissant que les systèmes de sécurité et de contrôle du véhicule restent intouchables pour les applications tierces. Pour vous, cela signifie une expérience similaire à celle d’un smartphone haut de gamme, avec la confiance que le « cœur » de la voiture demeure protégé des bugs et expérimentations logicielles.

Hyperviseurs automotive et virtualisation des ECU dans l’audi virtual cockpit

Pour gérer la complexité croissante des fonctions logicielles, les constructeurs recourent de plus en plus à la virtualisation via des hyperviseurs automotive. Dans une solution comme l’Audi Virtual Cockpit, un seul calculateur physique peut faire tourner plusieurs systèmes d’exploitation isolés (par exemple un OS temps réel pour les fonctions de sécurité et un OS basé sur Linux pour l’interface graphique). L’hyperviseur agit comme un chef d’orchestre, allouant finement les ressources processeur, mémoire et périphériques à chaque « machine virtuelle ».

Cette approche présente plusieurs avantages majeurs : réduction du nombre d’ECU, simplification du câblage, meilleure réutilisation logicielle entre modèles et, surtout, cloisonnement renforcé pour la cybersécurité. Même si une application d’infodivertissement était compromise, elle ne pourrait pas facilement accéder aux fonctions de freinage ou de direction, protégées dans une autre partition virtuelle. C’est une brique clé de la transition vers les software‑defined vehicles, où les fonctionnalités sont définies par logiciel plutôt que par le seul matériel.

En pratique, cette virtualisation permet aussi d’introduire de nouvelles fonctionnalités via des mises à jour sans reconfigurer tout le système. Vous pouvez par exemple bénéficier d’un nouveau mode d’affichage du combiné numérique, d’un pack ADAS supplémentaire ou d’une application de navigation plus avancée, sans changement matériel. Le véhicule devient alors une plateforme évolutive sur plusieurs années, ce qui améliore sa valeur résiduelle et son intérêt sur le marché de l’occasion.

Apis RESTful et SDK pour l’intégration des applications tierces spotify et waze

Pour enrichir l’expérience digitale embarquée, les constructeurs ouvrent progressivement leurs systèmes via des APIs RESTful et des SDK dédiés aux développeurs tiers. Des applications comme Spotify ou Waze peuvent ainsi s’intégrer plus profondément dans l’écosystème du véhicule : contrôle via les commandes au volant, affichage des indications de navigation dans l’instrumentation tête haute, adaptation du volume audio en fonction de la vitesse, etc.

Ces interfaces de programmation normalisées permettent à l’OS embarqué de dialoguer avec les services cloud et les applications mobiles de façon sécurisée. Du point de vue du développeur, la voiture devient un nouveau « device » à part entière, au même titre que le smartphone ou la tablette. Pour vous, conducteur, cela se traduit par une expérience plus fluide : vous retrouvez vos playlists, vos historiques de navigation et vos préférences personnalisées dès que vous montez à bord.

Les constructeurs restent toutefois très vigilants sur les droits d’accès accordés à ces applications tierces. L’objectif est de permettre l’innovation sans exposer les systèmes critiques. Des mécanismes de sandboxing, de permissions granulaires et de validation en amont (similaires à ceux des stores mobiles) sont mis en place pour filtrer les applications disponibles dans les boutiques embarquées et limiter les risques de comportements malveillants.

Systèmes OTA (Over-The-Air) et mise à jour firmware via tesla software updates

La capacité de mettre à jour la voiture à distance, sans passer par l’atelier, est l’une des révolutions majeures de ces dernières années. Tesla Software Updates a popularisé le concept de mise à jour OTA (Over‑The‑Air) : correction de bugs, amélioration de l’autonomie, ajout de nouveaux modes de conduite, voire déblocage de fonctionnalités payantes après l’achat initial. La voiture devient ainsi un produit en constante évolution, un peu comme votre smartphone.

Techniquement, ces mises à jour s’appuient sur la connectivité 4G/5G et sur des mécanismes de sécurité avancés : chiffrement bout‑en‑bout, signatures numériques des firmwares, vérification de l’intégrité avant installation. En cas de problème, un mécanisme de rollback permet de revenir à la version précédente pour éviter d’immobiliser le véhicule. Certaines mises à jour ne concernent que l’infodivertissement, d’autres touchent des fonctions plus sensibles comme la gestion moteur ou les ADAS, après des campagnes de validation intensives.

Pour vous, l’avantage est double : bénéficier régulièrement d’un véhicule « rafraîchi » (nouveaux services, interface modernisée, optimisation des performances) et limiter les visites en atelier pour des opérations purement logicielles. À l’échelle des flottes, la télématique OTA permet aussi de déployer en quelques heures une mise à jour de sécurité ou une nouvelle fonction d’éco‑conduite sur des centaines de véhicules, améliorant la sécurité et réduisant les coûts d’exploitation.

Capteurs IoT et acquisition de données télématiques

Au cœur de la voiture connectée se trouve un réseau dense de capteurs IoT qui mesurent en continu l’état du véhicule et de son environnement. Ces données télématiques alimentent à la fois les fonctions temps réel (sécurité, confort, performance) et les services cloud (entretien prédictif, assurance basée sur l’usage, optimisation de flotte). On estime qu’un véhicule moderne peut générer plusieurs téraoctets de données par jour, même si seule une fraction est effectivement transmise hors du véhicule.

Capteurs MEMS acceleromètres et gyroscopes pour la détection d’impact

Les capteurs MEMS (Micro‑Electro‑Mechanical Systems) occupent une place centrale dans la surveillance dynamique du véhicule. Les accéléromètres mesurent les variations rapides de vitesse sur plusieurs axes, tandis que les gyroscopes suivent les changements d’orientation et de rotation. Ensemble, ils constituent la base des systèmes de stabilité (ESP), de contrôle de traction, de détection de retournement et même des déclencheurs d’airbags.

En cas de choc, ces capteurs détectent en quelques millisecondes une décélération brutale qui dépasse un certain seuil, déclenchant la séquence d’activation des airbags et des prétensionneurs de ceinture. Ils sont également exploités dans les fonctions de confort et de connectivité : détection d’un accident pour l’envoi automatique d’un eCall aux services d’urgence, enregistrement des données d’événement dans une « boîte noire » ou encore analyse de style de conduite pour les services d’assurance connectée.

Leur faible consommation énergétique, leur compacité et leur coût relativement bas en font des composants incontournables de la voiture connectée. À mesure que les algorithmes d’analyse s’affinent, ces mêmes données d’accélération et de rotation servent aussi à détecter les routes dégradées, les nids‑de‑poule ou les comportements de conduite à risque, contribuant à une meilleure maintenance des infrastructures et à une sécurité routière renforcée.

Modules GPS multi-constellation GLONASS et galileo pour la géolocalisation précise

La géolocalisation est l’une des fonctions phares des véhicules connectés, bien au‑delà de la simple navigation. Les modules GNSS modernes (Global Navigation Satellite Systems) combinent plusieurs constellations : GPS (États‑Unis), GLONASS (Russie), Galileo (Europe) et parfois BeiDou (Chine). En exploitant davantage de satellites et des signaux plus précis (comme ceux de Galileo), ils améliorent nettement la précision de positionnement, qui peut descendre sous le mètre dans des conditions favorables.

Cette précision est cruciale pour les fonctions avancées de guidage de voie, de navigation dans les zones urbaines denses et, à terme, pour la conduite autonome. Couplé à la cartographie haute définition et aux capteurs embarqués, le GNSS multi‑constellation permet au véhicule de se localiser avec une grande confiance, même dans des environnements complexes. Pour les gestionnaires de flotte, ces modules GPS avancés fournissent aussi des données détaillées sur les itinéraires empruntés, les temps de pause, les zones de livraison ou les comportements de conduite.

Des techniques complémentaires comme le GPS assisté (A‑GPS) et la fusion avec les capteurs inertiels (IMU) compensent les pertes de signal dans les tunnels, parkings souterrains ou « canyons urbains ». L’ensemble constitue une « boussole numérique » fiable qui alimente non seulement la navigation, mais aussi les services d’assurance, de covoiturage, de logistique ou de mobilité partagée.

Capteurs de température moteur et pression pneumatiques avec protocole TPMS

Les capteurs plus classiques – température moteur, niveau d’huile, pression du liquide de refroidissement – demeurent essentiels pour la santé mécanique du véhicule, mais leur rôle évolue dans le contexte connecté. Ils ne se contentent plus d’allumer un voyant au tableau de bord : leurs données sont agrégées, analysées et parfois transmises au cloud pour alimenter des modèles de maintenance prédictive. Une surchauffe légère et répétée, par exemple, peut déclencher une alerte avant qu’une panne grave ne survienne.

Le système de surveillance de la pression des pneus, ou TPMS (Tire Pressure Monitoring System), est devenu obligatoire dans de nombreux pays. Il repose sur des capteurs embarqués dans chaque roue, qui transmettent en temps réel la pression et parfois la température de chaque pneu à un calculateur central. Une perte de pression anormale déclenche une alerte immédiate, réduisant les risques d’éclatement et améliorant la consommation de carburant.

Dans une voiture connectée, ces informations peuvent aussi être partagées avec votre application mobile ou le centre de maintenance. Imaginez recevoir une notification la veille d’un long trajet vous signalant qu’un pneu est sous‑gonflé et vous proposant un rendez‑vous dans le garage le plus proche. À l’échelle des flottes, l’analyse agrégée des données TPMS permet d’allonger la durée de vie des pneus, d’optimiser les plannings de rotation et de réduire les coûts d’exploitation.

Caméras haute résolution et capteurs ultrasoniques pour l’aide au stationnement

Les systèmes d’aide au stationnement font partie des premières fonctionnalités « intelligentes » adoptées massivement par le grand public. Ils combinent généralement des capteurs ultrasoniques (pour mesurer la distance aux obstacles à faible vitesse) et des caméras haute résolution positionnées à l’avant, à l’arrière et parfois sur les rétroviseurs. L’ensemble permet de générer une vue 360° autour du véhicule, affichée en temps réel sur l’écran central.

Les capteurs ultrasoniques émettent des ondes sonores et calculent le temps de retour pour estimer la distance à un obstacle, même dans l’obscurité complète. Les caméras, quant à elles, apportent le contexte visuel et permettent la détection automatique des places de stationnement disponibles. Certains systèmes vont plus loin avec le parking automatisé : vous n’avez plus qu’à contrôler l’accélérateur et le frein, voire à sortir du véhicule pendant qu’il se gare tout seul.

À mesure que la résolution des caméras augmente et que les algorithmes de vision par ordinateur progressent, l’aide au stationnement devient plus précise, plus rapide et plus sûre. Des fonctions comme la détection de piétons ou d’objets en mouvement à proximité du véhicule à basse vitesse contribuent aussi à réduire les sinistres matériels fréquents (chocs à basse vitesse, rayures, pare‑chocs endommagés), ce qui intéresse particulièrement les assureurs et les gestionnaires de flotte.

Cybersécurité automobile et protection des données véhicule

Plus un véhicule est connecté, plus sa surface d’attaque potentielle s’élargit. La cybersécurité automobile est donc devenue un sujet critique, au même titre que les freins ou les airbags. Les constructeurs doivent protéger à la fois l’intégrité des systèmes (empêcher une prise de contrôle malveillante) et la confidentialité des données (localisation, habitudes de conduite, informations personnelles des occupants). Les nouvelles réglementations, comme le règlement UNECE R155 en Europe, imposent désormais des exigences strictes en matière de gestion des risques cyber tout au long du cycle de vie du véhicule.

Concrètement, plusieurs couches de défense sont mises en place : segmentation des réseaux internes (séparation stricte entre infotainment et fonctions critiques), systèmes de détection d’intrusion (IDPS) spécifiques à l’automobile, chiffrement des communications (TLS) entre le véhicule et le cloud, authentification forte des mises à jour OTA. Les boîtiers télématiques et passerelles réseau deviennent des « pare‑feux » intelligents, capables de filtrer les flux suspects et de limiter l’impact d’une éventuelle compromission.

La protection des données personnelles repose également sur des principes de privacy by design : minimisation des données collectées, anonymisation ou pseudonymisation quand c’est possible, stockage local par défaut, et consentement explicite de l’utilisateur pour tout partage avec des tiers (assureurs, opérateurs de mobilité, partenaires commerciaux). Dans un contexte de RGPD, les entreprises doivent être transparentes sur les finalités de chaque traitement et offrir des mécanismes simples pour exercer ses droits (accès, suppression, portabilité).

Pour vous, cela signifie qu’il devient essentiel de vérifier les politiques de confidentialité proposées par les constructeurs et services associés. Souhaitez‑vous partager votre style de conduite avec votre assureur en échange d’une réduction de prime ? Êtes‑vous prêt à transmettre vos trajets à un opérateur de mobilité pour bénéficier de recommandations personnalisées ? La voiture connectée ouvre de nouvelles possibilités, mais elle vous place aussi au centre des décisions concernant l’usage de vos données.

Interface utilisateur et expérience digitale embarquée

Enfin, toutes ces technologies n’ont de sens que si elles se traduisent par une expérience utilisateur fluide, intuitive et agréable. L’interface homme‑machine (IHM) d’une voiture connectée moderne combine écrans tactiles haute résolution, commandes vocales, affichage tête haute (HUD), retour haptique et parfois même reconnaissance gestuelle ou faciale. L’objectif est de vous donner accès à un univers de services numériques tout en minimisant la distraction au volant.

Les grands écrans panoramiques, popularisés par des systèmes comme le MBUX de Mercedes ou le Virtual Cockpit d’Audi, permettent de personnaliser en profondeur l’affichage : cartographie en pleine largeur, widgets de consommation énergétique, vue caméra 360°, applications musicales, etc. La tendance est à la création d’un « troisième lieu » confortable entre la maison et le bureau, où l’on peut travailler, se divertir ou se reposer, en particulier dans la perspective de la conduite autonome.

L’expérience digitale embarquée repose aussi sur la continuité avec vos autres appareils. Votre profil utilisateur (siège, rétroviseurs, climatisation, ambiances lumineuses, favoris multimédia) peut suivre votre clé numérique ou votre smartphone d’un véhicule à l’autre. Les enfants peuvent profiter de contenus adaptés sur les écrans arrière, tandis que vous affichez vos applications professionnelles à l’avant. Grâce à l’IA, l’interface anticipe vos besoins : proposer un café lorsque vous avez roulé plus de deux heures, suggérer un itinéraire plus économique quand la batterie est faible, ou adapter la luminosité des écrans à votre niveau de fatigue apparent.

À mesure que les voitures deviennent de véritables plateformes logicielles, l’UX embarquée deviendra un facteur de différenciation majeur entre marques, au même titre que le design ou les performances moteur. Pour les conducteurs comme pour les gestionnaires de flotte, cela signifie qu’il faudra bientôt évaluer un véhicule autant sur sa qualité logicielle (ergonomie, rapidité, richesse de l’écosystème d’applications, fréquence des mises à jour) que sur ses caractéristiques mécaniques traditionnelles.